英伟达发布!黄仁勋:1万亿美元营收

北京时间3月17日凌晨,英伟达CEO黄仁勋在2026年GTC大会上发表主题演讲。他谈到算力芯片的最新营收预测:到2027年达到1万亿美元。上一年黄仁勋曾预测,2026年芯片的市场需求约5000亿美元。

黄仁勋认为,过去三年,AI产业的3个里程碑式产品分别是ChatGPT、OpenAI的o1推理模型,以及Claude Code智能体。ChatGPT开启生成式AI时代;o1推理模型使模型能够反思、规划,将复杂问题分解为可处理的步骤;Claude Code则革新了软件工程。AI经历了从“感知”到“生成”,再到“推理”“执行”的演进。

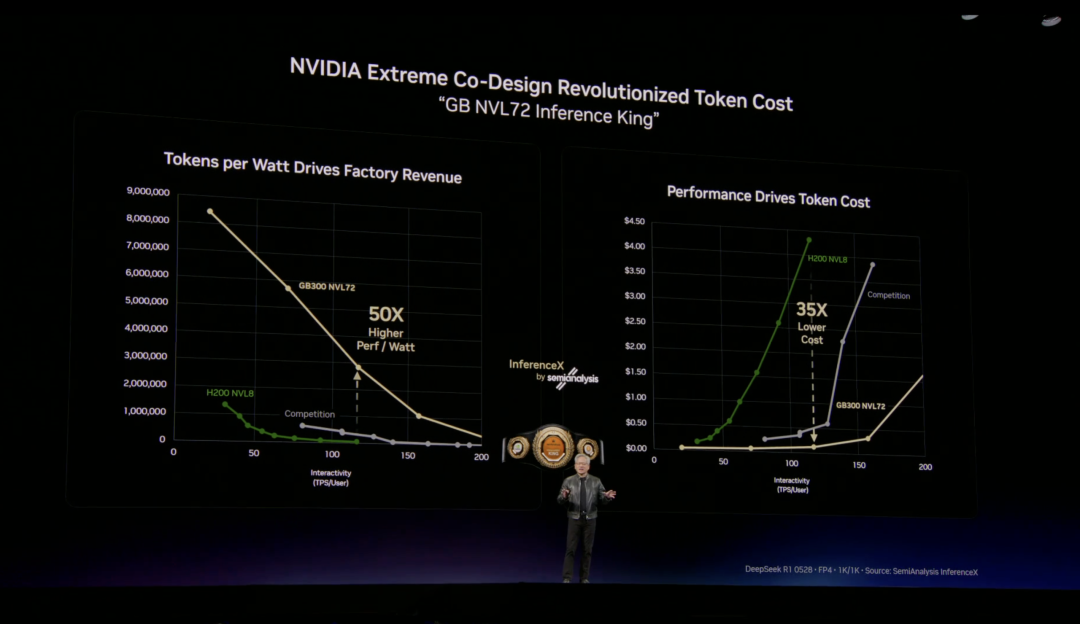

黄仁勋表示,推理拐点已经到来,Token生成需求呈爆炸式增长。黄仁勋在演讲中提到“每瓦Token数”(Tokens per watt)的概念,他表示,英伟达的Token成本目前是全球最低。

英伟达CEO黄仁勋在2026年GTC大会上发表主题演讲图片来源:英伟达视频截图

黄仁勋介绍,目前英伟达约60%的业务来自超大规模云厂商,40%来自云服务、企业客户、机器人等其他领域。

英伟达硬件进展

黄仁勋展示了Vera Rubin平台。他介绍,Vera Rubin是由7款芯片、五种机架系统组成的巨型超级计算。英伟达表示,该平台搭载的7款新芯片现已全面投产,旨在扩展全球最大AI工厂的规模。

Vera Rubin NVL72集成了72个Rubin GPU和36个Vera CPU,与Blackwell平台相比,Vera Rubin NVL72仅需四分之一数量的GPU即可训练大型混合专家模型,每瓦特推理吞吐量最高可提升10倍,同时每Token成本仅为原平台的十分之一。

英伟达还发布全新的Vera CPU机架,该机架集成256个液冷Vera CPU,AI工厂可在单个机架内快速部署并扩展至数万个并发实例和智能体工具,效率比传统机架级CPU提升一倍,速度提升50%。

黄仁勋还介绍了Groq 3 LPX机架,该机架专为智能体系统的低延迟和长上下文需求而设计,整套LPX机架包括256个LPU处理器,配备128GB片上SRAM和640TB/s的纵向扩展带宽。LPX与Vera Rubin NVL72协同部署时,Rubin GPU和LPU通过协同计算AI模型的每一层来生成每一个Token,使得每兆瓦的推理吞吐量提升高达35倍。

此外,黄仁勋还介绍了Spectrum-6 SPX交换机,其采用了共封装光学(CPO)技术,能够在大规模部署中提供低延迟、高吞吐量的机架间互连,相比传统可插拔收发器,其光学能效最高提升5倍,系统可靠性提高10倍。

会上,英伟达推出用于太空数据中心的Vera Rubin模块,并宣布将推出新一代AI图形技术DLSS 5,可为游戏画面实现更真实的光照和材质效果,预计今年秋季上线。

一键“养虾”

会上,黄仁勋宣布推出NemoClaw,该产品定位为OpenClaw(龙虾)智能体平台的基础设施层,可通过“一条命令”部署AI代理,并集成Nemotron模型和OpenShell运行环境,补齐安全、隐私与沙箱能力,实现便捷且安全地“养虾”。

黄仁勋表示,英伟达与OpenClaw开发者以及专家们合作,打造了一整套智能体AI工具链,确保AI代理在公司内部执行任务时是安全的。

同时,英伟达宣布成立“Nemotron联盟”,联合多家全球AI实验室共同开发开放式前沿基础模型,通过共享数据、算力与研究成果加速AI创新。英伟达同时发布开源智能体软件套件,为企业和开发者提供构建与运行AI智能体的软件平台。